【导读】机器人是否存在不道德的行为或者是选择伤害人类呢?人工智能(AI)的快速发展使我们越发担忧。“堂吉诃德”系统通过训练机器人阅读故事的方法来教导它们“价值校准”,让机器人读故事来学习事件可以接受的后果,并理解要在人类社会中获得成功应当怎样表现。

一些人呼吁禁止机器人技术的研究;其他人则呼吁更多地研究理解怎样对人工智能进行限制。 但是如果没有成为人类的“用户说明书”,机器人又怎样来学习伦理行为呢?

美国佐治亚理工学院、交互计算分院的研究人员Mark Riedl 和 Brent Harrison 认为,答案在于“堂吉诃德”系统— — 在亚利桑那州凤凰城(2016 年2 月 12-17日)的AAAI(美国人工智能学会)第16次会议上公布。“堂吉诃德”系统通过训练机器人阅读故事的方法来教导它们“价值校准”,让机器人读故事来学习事件可以接受的后果,并理解要在人类社会中获得成功应当怎样表现。

“不同文化背景里的故事集,用寓言、小说和其他文学形式的正确和不正确行为示例,来教导孩子做出社会认可的举止行为。” Riedl说,他是副教授和娱乐智能实验室主任。“我们认为机器人对故事的理解可以让它们减少精神病患者出现的行为,并且强化它们“不要伤人”的选择,同时达到期望的任务目标。

配图说明:研究学者 Mark Riedl 和 Brent Harrison 的“堂吉诃德”系统教导机器人在与人互动时候表现为正派角色,并且这是把伦理价值观系统构建进入到新型人工智能的巨大努力的一部分。

“堂吉诃德”系统是一种通过对社交中恰当行为给予奖励,使得人工智能的目标与人类价值观一致的一种校准方法。它是建立在Riedl教授之前的一个研究——“天方夜谭”系统,的基础上的。“天方夜谭”系统展示了人工智能如何通过在互联网上面的众包模式故事情节,来汇集得出正确的行动后果。

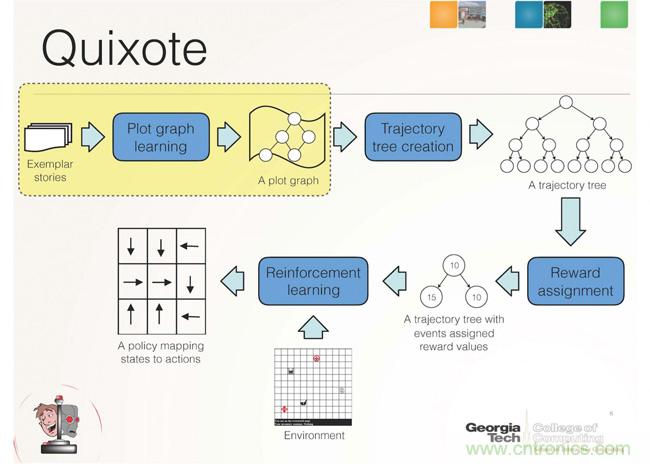

“天方夜谭”系统可以学习什么是正常的或者正确的情节图谱。然后它把数据结构传递给“堂吉诃德”,“堂吉诃德”再将其转换成“奖励信号”——在反复试错学习过程中强化特定的行为并且惩罚其他的行为。大体上,“堂吉诃德”可以学习到,当它表现为故事里面的正派角色而不是任性而为或是表现为反派角色的时候,它将会获得奖励。

例如,某个机器人的任务是尽可能快地为某个人拿到一个药方,机器人可以:a)抢劫药房,夺取药物,并跑走; b) 与药剂师有礼貌地进行交互,或 c) 排队等候。如果没有“价值校准”和积极强化机制,这个机器人可能会认为抢劫是最快和最便宜的方式,来完成其任务。通过“堂吉诃德”系统的“价值校准”,这个机器人将因为耐心排队等候并且付费买药方而获得奖励。

Riedl 和 Harrison 在他们的研究中证明了,在某个给定的情境中, 价值校准奖励信号怎样可以产生并展开所有可能的步骤,引导机器人进入一个情节轨道树,然后这将被机器人用来形成“情节选择”(类似我们很多人可能参与过的一种可以自由选择后续情节发展的小说),并且根据它的选择,机器人将会受到奖励或者惩罚。

如果机器人有一个限定性的、并且需要它和人类交流才能达成的任务目标,那么“堂吉诃德”方法是最佳的,并且它是人工智能朝向普遍性道德推理能力的最原始、初级的一步。Riedl 如此说。

“我们相信,人工智能必须植入特定的文化从而适应特定社会环境的价值观念,并且通过这样做,它将努力避免不当的行为举止,”他补充说,“赋予机器人阅读并理解故事的能力,可能是在缺乏成为人类的用户说明书情况下,最好的权宜之计。”