【导读】在过去的2~3年间,端到端技术大规模铺开,为辅助驾驶体验带来了显著进展。与此同时,基于推理能力的人工智能出现,使行业真正迎来了一个类似ChatGPT的里程碑时刻。从当前技术发展来看,通往L4级完全自动驾驶甚至无人驾驶的道路已经相对清晰。在这一大背景下,英伟达(NVIDIA)一直在努力推动整个行业尽早实现L4级自动驾驶,比如今年推出了面向辅助驾驶汽车的开放模型Alpamayo,成为今年L4发展的一个重要里程碑。

不过,通向L4的道路一定需要一个完整的平台化的解决方案,英伟达其实一直在朝向这个方向努力。对于L4级自动驾驶,英伟达当下的打法究竟是怎么样的?2026年,北京车展期间,英伟达全球副总裁吴新宙向包括EEWorld在内的媒体进行了深度分享。

自动驾驶是物理AI最早量产场景

“提供全栈解决方案只是工作的一部分,对英伟达而言更重要的使命是赋能整个产业,推动其尽快向L3或L4级无人驾驶能力发展。“吴新宙如是说。

他介绍,英伟达一直是人工智能领域 重要的推动者。自动驾驶作为人工智能最大的受益者之一,其发展历程与AI技术演进密不可分。2012年AlexNet出现后,感知AI能力使许多传统计算机视觉难以解决的问题得以通过数据驱动的方法解决。2017年Transformer架构打开了新的大门,首次实现360度感知的稳定与优秀表现,使基于BEV的感知得以落地,全模型方法开始应用于规控领域。近两年出现的代理式AI,特别是大语言模型带来的推理能力,成为高效且规模化解决所有边缘场景问题的关键钥匙。

从感知AI到代理式AI,最终落地到物理世界,就是物理AI。英伟达创始人兼首席执行官黄仁勋多次强调,未来十年是公司乃至整个产业和科技行业最核心的挑战。

吴新宙强调,“英伟达坚信,自动驾驶将是物理AI领域最早实现量产和大规模落地的场景。”

从经济价值看,全球每年车辆行驶里程约为13万亿英里,其中自动驾驶历程仅为7亿英里,占比仅为0.006%左右,几乎可以忽略不计。英伟达相信 每一英里最终都将变为自动驾驶。若每英里自动驾驶解决方案价值1~2美元,这将是一个体量巨大的市场。更重要的是,技术已经发展到能够实现L4的时间节点,这是令人激动的时刻。

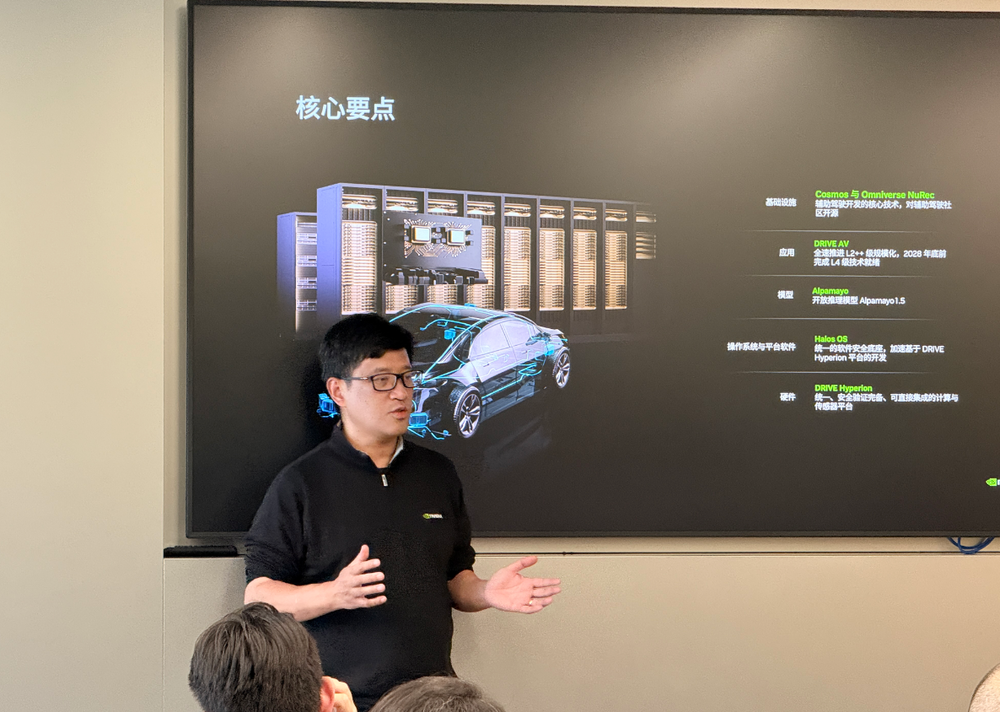

五层“蛋糕”服务架构

解决物理AI问题需要三台关键计算机:第一台是车端计算机,英伟达已在这方面投入十年时间,做了大量工作;第二台是云端训练计算机,所有模型都在英伟达的CUDA生态中成长,该生态是所有模型的根基;第三台是仿真计算机,在端到端模型时代,仿真变得尤为重要。

英伟达在这三台计算机上都投入了强大的产品,助力物理AI的发展。基于三大计算平台,英伟达构建了五层“蛋糕”的技术服务架构,吴新宙逐层进行了介绍:

第一层,基础设施:NVIDIA Cosmos and Omniverse NuRec

涵盖云端训练、数据处理、标注、仿真验证等全流程工具。英伟达凭借数十年图形技术积累,具备物理世界像素级重建、照片级虚拟场景生成能力,可高效支撑辅助 驾驶模型训练与验证,日均完成 200万次场景仿真验证,通过场景编辑、环境倍增等技术,将数据验证效率提升5~10倍。

第二层,应用:NVIDIA DRIVE AV

为缺乏自主研发能力的车企提供一站式 “交钥匙” 解决方案,目前已与奔驰、Lucid等多家车企达成深度合作,助力其车型快速具备高阶辅助 驾驶能力。

第三层,开放模型:NVIDIA Alpamayo

Alpamayo是秘鲁一座著名的山峰,被称为最美丽但也最难攀登的山。这个名字恰如其分地形容了解决端到端辅助 驾驶问题的难度。英伟达所做的是通过硬件、操作系统和开放模型,尽可能降低这一门槛。

车厂或软件提供商可以从Alpamayo开始进行微调,产生产品级方案,在英伟达硬件平台和操作系统上顺畅运行。Alpamayo模型在Hugging Face上获得了第二名的下载量,在LingoQA榜单上的辅助驾驶推理模型排名第一。

今年GTC期间,英伟达发布的Alpamayo的1.5版本,新增了导航能力,并增加了灵活的多摄像头支持和可配置的摄像头参数,简化了同一套 AI 驾驶栈在不同车型、不同传感器配置中的复用,同时保留与现有Alpamayo集成的兼容性。吴新宙预告,今年6月将发布2.0版本,模型能力持续迭代。

训练Alpamayo模型使用了8万小时驾驶数据,但因其主干基于Cosmos系列蒸馏而来,而Cosmos是基于互联网和YouTube等全球视频数据训练的基础模型,因此继承了对物理世界的深刻理解,再针对驾驶数据进行最后的微调。

第四层,操作系统和平台软件:NVIDIA Halos OS

Halos OS是对原有Drive OS的扩充。Drive OS是运行在芯片中的操作系统软件,英伟达以最高安全等级要求进行开发,使车厂或软件开发者可以在安全无后顾之忧的情况下,在英伟达平台上开发车用软件。

对Halos OS的扩充包括加入Halos SDK,使车厂能够更容易地开发软件。其中包含车辆扩展层和传感器扩展层,将这两层标准化后,车厂适配不同硬件、传感器或车辆的工作量将大幅减少。

此外,Halos OS还将主动安全系统和一些基于规则的经典算法纳入其中。模型供应商或软件开发者可以在最高安全等级的硬件和底层操作系统上,利用规则兜底方案,更容易地通过各种安全认证,包括中国的CNCAP、美国的FMVSS、NCAP等。

第五层,硬件:NVIDIA Drive Hyperion

涵盖车载计算芯片与传感器,英伟达和业界一同定义了支持 L4 级无人驾驶的标准化硬件平台,实现数据互通共享。

Drive Hyperion平台基于Thor芯片架构打造,该架构也是云端大模型训练的核心算力支撑。针对车载端存储带宽限制,芯片支持FP4精度,有效提升算力利用率,总算力较前代产品大幅提升。

传感器配置分为基础版与高阶版:基础版以纯视觉+毫米波雷达为主,配备10个高清外置摄像头、3个毫米波雷达、12个超声波传感器、1个DRIVE AGX Thor,可支撑优质L2+级体验;高阶版面向L3、L4 级,配备14个高清外置摄像头、9个毫米波雷达、12个超声波雷达、1个激光雷达,2个DRIVE AGX Thor架构ECU,实现控制器与传感器全冗余,确保单点失效下系统仍可完成最小风险操作,保障行驶安全。依托该标准化配置,英伟达正与合作伙伴采集百万小时级驾驶数据并向生态开放,大幅降低行业数据门槛。

英伟达辅助驾驶的核心战略

吴新宙强调,英伟达想要推动行业采用Drive Hyperion标准化平台,该平台硬件与传感器均经过充分验证,可实现数据互通共享;同时推广Halos OS高安全等级操作系统,降低开发者门槛;持续开放 Alpamayo模型、配套数据与工具,削减行业研发成本;最终为有需求的车企提供全栈解决方案。

英伟达在辅助驾驶领域已深耕十年,从早期芯片供应,逐步拓展至云端训练中心、全栈车载解决方案。2017年英伟达率先提出端到端辅助驾驶解决方案,2020年与奔驰达成合作,2025 年完成欧美地区方案交付,后续还将与更多车企展开合作。

当前英伟达的算法栈采用混合端到端架构,以模仿学习为核心,实现类人驾驶体验,同时并行运行经典规则算法栈,形成安全护栏。2025年,该方案在欧洲E-NCAP测评中斩获年度第一。量产方案迭代频次极高,日均完成海量仿真验证。通过经典算法兜底,可有效提升驾乘安全性与舒适度,应对各类复杂路况。

目前,英伟达正推进L2++全球化规模化落地,已完成旧金山、洛杉矶、纽约、伦敦、慕尼黑等城市路测,目标在2026年实现全球化量产。与此同时,方案正加速向L3、L4级迁移,通过双算法栈冗余、硬件冗余与激光雷达加持,满足高阶自动驾驶的安全要求。

从时间规划来看:2025年官宣与奔驰合作进展;2026年实现L2++点对点功能在美国落地,并拓展至欧洲等地区;2027年计划与合作伙伴在部分城市开展L4试点;2028年为洛杉矶奥运会提供L4级无人驾驶服务,计划覆盖20~30个城市。

除辅助驾驶外,英伟达还依托 AI 技术深度赋能车企整车设计、生产制造、产线规划等环节,助力车企全流程智能化升级,提升运营效率。

英伟达对于当下辅助驾驶的判断

谈及当下争议不休的激光雷达,吴新宙给出了判断:对于L2+级辅助驾驶,纯视觉路线不仅可行,其感知上限“极高”,视觉模型所依赖的像素密度远超激光雷达。然而,当系统迈向L3与L4级时,激光雷达的角色便从可选变为必要。“它是实现传感器冗余、保障安全的关键部件。” 目前,英伟达正联合欧美产业链伙伴,持续推进激光雷达供应的稳定性,为L3、L4级技术的规模化落地筑牢基础。

有人说,L3这一阶段会被跳过,行业会直接步入L4阶段。对此,吴新宙表示,从技术层面来看,当前辅助 驾驶已经没有核心卡点。随着生成式AI和推理AI的发展,以往难以解决的极端场景、决策逻辑等问题,都已经有了可行的解决方案。现在的主要挑战在于系统工程的整合和规模化落地的工程量。

他指出,辅助驾驶不是单一技术的突破,而是硬件、软件、数据、仿真等多环节的协同,需要大量的工程迭代和验证。至于L3与L4级,两者在技术难度上差距并不大,更多是应用场景和责任界定的差异:L3要求驾驶员在10秒内接管车辆,这10秒内车辆需承担完全责任,它在高速场景下能有效解放驾驶员双手,具备明确的用户价值;而L4级则更多依赖云端远程运营支撑,对于年销百万辆的车企而言,为每辆车配备这种能力成本极高。

因此,短期内L3与L4级将并行发展,一个服务于个人出行的效率提升,一个运行于运营场景的商业闭环。

舱驾融合是当下行业一大趋势,吴新宙表示,车辆本质上其实也是一种移动机器人,座舱交互与辅助驾驶对安全等级要求不同,短期内可能不会共用同一颗芯片。但大模型的能力将逐步共享,最终走向感知、决策与交互的一体化。在辅助驾驶芯片上同时提供人机交互能力,这是非常值得期待的方向。

同样值得期待的,还有辅助驾驶与机器人赛道的重合关系。吴新宙将两者都归入物理AI的核心范畴,但它指出辅助驾驶已率先接近规模化落地的临界点。英伟达同样看好机器人,但眼下,辅助驾驶是物理AI浪潮中最先涌起的那个浪头。

面对部分车企掀起的自研芯片浪潮,吴新宙也真诚地保持欢迎和开放的心态。“英伟达并不排斥车企自研芯片,”他说,“我们始终以推动整个生态发展为核心。”即便一家车企完全放弃了英伟达的车载推理芯片,它可能仍然离不开英伟达的云端训练、仿真算力与开源技术。在吴新宙看来,AI产业整体的发展,最终一定会反哺英伟达的算力需求,这是一场没有输家的共生游戏。