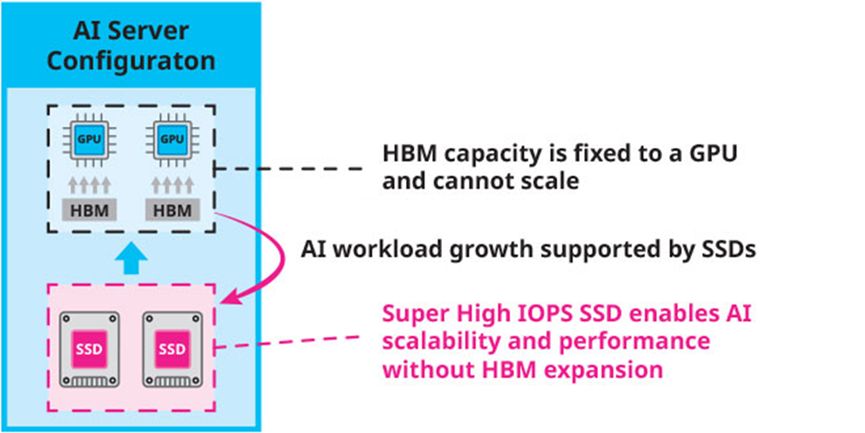

【导读】AI已经进入了以生成式AI、智能体AI的发展阶段。依靠大语言模型,用户可以通过AI完成智能决策和信息流程处理自动化。在AI与GPU协同运作的经典场景中,高带宽内存HBM(High Bandwidth Memor)为GPU高频访问数据提供高速连接通道,特别是模型权重、KV Cache等高频访问数据需要大量HBM,但直接扩容成本高昂且存在物理限制。

可以这么说,HBM的容量直接决定了AI系统能否满足多任务需求,例如可支持的模型规模上限、模型可处理的上下文窗口长度,或是可同时支持的用户数。但现实也是骨感的,由于AI应用的持续增长,再加上目前AI系统过于依赖HBM,导致HBM容量需求攀升,而高昂成本的HBM不是说想扩容就扩容的,由于制造工艺极端复杂、供应链高度集中、物理空间受限三重因素叠加,在短时间内解决扩容问题不太现实。

作为存储行业引领者,铠侠敏锐的观察到SSD有巨大的潜力,能够帮助GPU与AI缓解对HBM容量的需求。通过开源的Big Accelerator Memory(BaM)框架,允许GPU直接访问SSD数据,无需经过CPU或者系统内存,为GPU级别的数据传输能力奠定了基础。

而从存储层面来看,如果想紧跟GPU发展节奏,依靠现成的SSD产品是远远不够的。为此,铠侠专门打造一款超高速IOPS SSD,帮助AI系统在极小数据块场景下实现单盘性能的突破性提升,从而满足AI应用不断升级的需求。

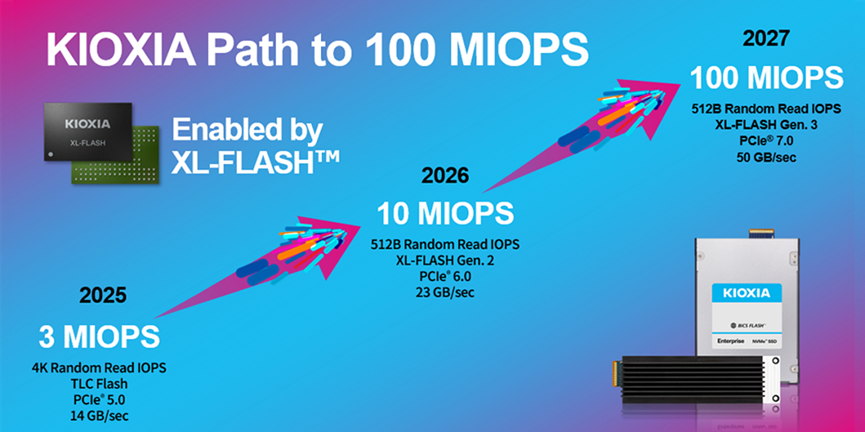

在FMS 2025上,铠侠首次预告了这款超高IOPS SSD存在,512B随机读取性能可突破1亿IOPS,同时也验证了这套方案在BaM架构下实现的可能性,为后续产品化奠定了基础。1亿IOPS SSD意味着,可以有效分担原本仅能由HBM承担的高频访问负载,并获得远比HBM更大的容量,从而构建出一套依托大容量、高性能 GPU 直连存储池的全新架构。

这套方案很快收到了业内的关注,在共同努力下,基于BaM架构的解决方案蓬勃发展。例如NVIDIA推出了NVIDIA Storage-Next™技术,只在NVMe™ SSD 深度集成至 GPU I/O 链路的解决方案。在今年GTC 2026上,铠侠围绕这项技术正式推出了全新的KIOXIA GP系列SSD,向1亿IOPS SSD产品化迈出了坚定的一步。

支持1亿IOPS背后的技术源自于铠侠对XL-FLASH™技术的灵活应用。XL-FLASH™是铠侠开发的一种具有极低延迟、高性能特性的闪存,在很长时间中作为存储级内存(Storage Class Memory,SCM)使用。全新的KIOXIA GP系列SSD正是基于XL-FLASH™技术的不断演进,让企业级SSD的随机读写操作性能,由600万左右IOPS,提升至于1亿IOPS,这是一场非常夸张的跨越,也证明了这项技术未来的广阔前景。

超高IOPS可以进一步帮助系统提升响应灵敏度。特别是在当下,现代AI服务器配备大量昂贵GPU,但若存储层无法快速提供海量小数据块的随机访问(推理阶段的典型负载),GPU算力将被迫空闲等待。拥有超高IOPS的GP系列SSD通过极致随机读取性能消除这一瓶颈,提升AI基础设施整体效率。也进而解决GPU饥饿(GPU Starvation)的核心问题。

不仅如此,GP系列已经开启了不断进化的征程,初代GP系列SSD基于 PCIe® 6.0 标准研发,第二代产品则瞄准 PCIe® 7.0 标准布局,将 1 亿 IOPS 的性能里程碑变成现实。

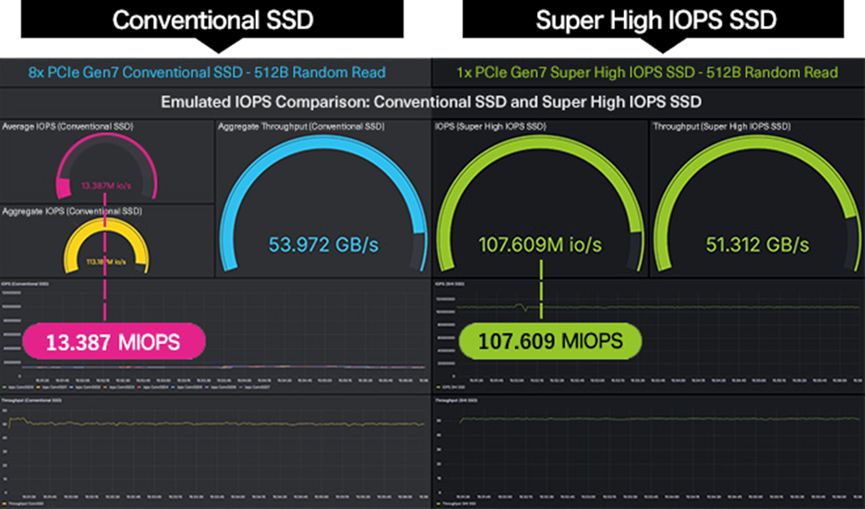

在现阶段,GP系列已经在模拟环境实现了验证。下图左侧传统 SSD 的性能约为 1300 万 IOPS,而模拟的超高 IOPS SSD(左起第三张图)性能则一举突破 1.07 亿 IOPS。凭借该技术,开发者可提前接触这款下一代存储设备,提前完成软件栈适配与优化,从而充分释放超高 IOPS SSD 带来的前所未有的速度潜力。铠侠计划于 2026 年末启动 KIOXIA GP 系列初代产品的样品交付,并于 2027 年内推出第二代产品。

铠侠GP系列SSD的诞生,也标志着存储角色从数据仓库向AI算力扩展内存转变——SSD不再只是存放冷数据,而是成为GPU的热数据缓存层,与HBM协同构成分级存储架构,以更低成本支撑更大模型、更长上下文窗口和更多并发用户。同时,铠侠也将不断努力,与行业合作伙伴携手,将XL-FLASH™技术等前沿技术推向市场,共同提升AI系统的运行效率。